Смотрю в книгу — вижу набор статистических данных. Почему искусственный интеллект невозможно научить читать?

Иногда кажется, что нейросети могут почти всё: они сочиняют музыку, создают изображения — но при этом не справляются с тем, что под силу пятилетнему ребенку. Рассказываем, почему искусственный интеллект не в состоянии читать тексты и понимать их смысл.

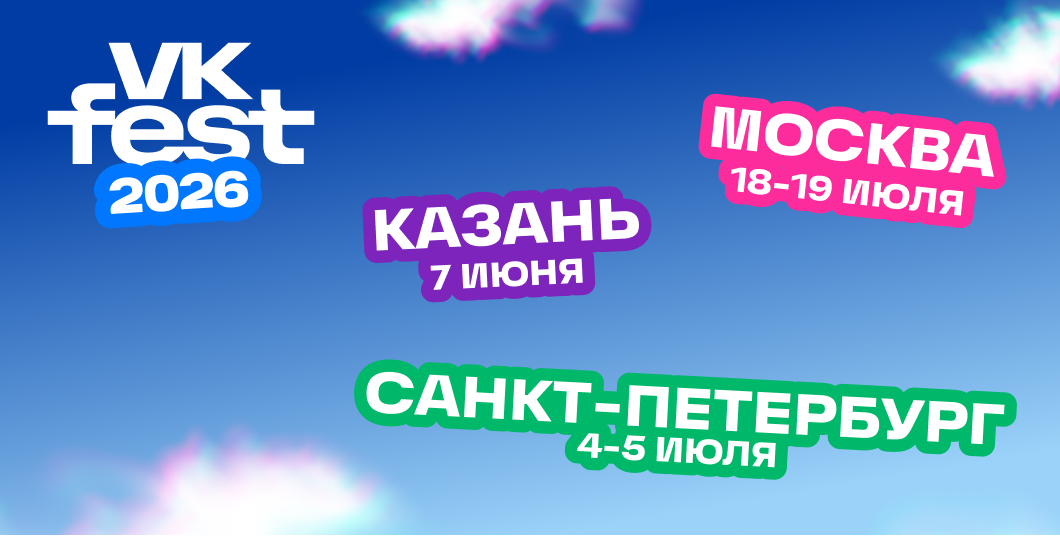

Футурист, изобретатель и технический директор Google Рэй Курцвейл в ходе своего выступления на конференции TED в 2018-м рассказал об одном из своих последних проектов — Google Talk to Books. По словам Курцвейла, с помощью этого проекта «чтение книг превратится в принципиально иной процесс». Предполагается, что новый инструмент сможет ответить на любой вопрос, проводя поиск по тысячам книг.

Было бы прекрасно, если бы он действительно умел это делать, но, увы, это пока не так, пишет Wired.

Чего не хватает современным компьютерам — так это способности понимать естественный язык людей.

А как бы нам пригодились их мощности! В той же медицине, к примеру, каждый день публикуются тысячи новых научных работ; никакой врач или исследователь не способен осилить такой объем. Мы не успеваем разрабатывать новые фармацевтические препараты, поскольку огромное количество информации попросту оказывается непрочитанным. Новые лекарства не применяются вовремя, поскольку врачи-терапевты не успевают о них узнавать.

Если бы системы искусственного интеллекта могли синтезировать информацию из медицинской литературы (или хотя бы уметь составлять списки дел на основе вашей рабочей переписки) — это было бы настоящей революцией.

Если познакомиться с инструментом вроде Google Talk to Books (GTB) поближе, можно быстро понять, что до машинного чтения тут далеко. Если спросить у платформы «Где Гарри Поттер познакомился с Гермионой Грейнджер?», только шесть из 20 ответов будут касаться Гарри Поттера; в остальных будут упоминаться другие люди с именем Гарри или вовсе выдаваться результаты, не связанные с вопросом. С вопросом о том, кто был главным судьей Верховного суда США в 1980-м, инструмент тоже не справился. При этом любой человек может спокойно найти ответ на этот вопрос в поисковике.

Кроме того, ответы GTB зависят и от того, как именно задается вопрос системе. Если спросить «Кто предал своего учителя за 30 серебреников?», только три ответа из 20 укажут на Иуду. Еще хуже обстоят дела, если убрать указание на серебреники и задать вопрос «Кто предал своего учителя за 30 монет?». В этом случае упоминание Иуды появится только в одном случае из 20; а при вопросе «Кто продал своего учителя за 30 монет?» Иуда вообще исчезает из 20 верхних ответов.

Чтобы понять, почему машинное чтение долго будет оставаться мечтой, задумайтесь о тех навыках, которые требуются для восприятия и понимания самой простой детской сказки.

Возьмем, к примеру, небольшой отрывок из повести Лоры Инглз-Уайлдер «Маленький фермер». Девятилетний Альманцо находит на улице кошелек с деньгами. Его отец полагает, что кошелек принадлежит мистеру Томпсону. Альманцо отправляется на его поиски и обнаруживает мистера Томпсона в одном из магазинов города.

Альманцо спросил у мистера Томпсона: «Не теряли ли вы кошелек?». Мистер Томпсон даже подпрыгнул от неожиданности. Он похлопал по своему карману и воскликнул:

— А как же, терял! И полторы тысячи долларов в придачу! А что такое? Ты его видел?

— Это он? — спросил Альманцо.

— Да-да, он! — ответил мистер Томпсон, выхватывая кошелек из рук Альманцо. Открыв кошелек, он поспешно пересчитал наличность. Потом пересчитал ее еще раз... Наконец он облегченно вздохнул и сказал: — Что ж, этот дрянной мальчишка ничегошеньки оттуда не свистнул.

Если бы система искусственного интеллекта умела читать книги, она смогла бы ответить на такие вопросы:

- Почему мистер Томпсон похлопал по своему карману?

- Знал ли мистер Томпсон о том, что он потерял кошелек, до того, как с ним заговорил Альманцо?

- Какой предмет имеет в виду Альманцо, спрашивая «Это он?»

- Все ли деньги были на месте?

Человеку легко найти ответы на эти вопросы, а вот искусственный интеллект не сможет с ними справиться.

Дело в том, что каждый из этих вопросов требует целой серии умозаключений, основанных на косвенных данных.

Сегодняшние технологии пока не умеют считывать контекстуальный смысл. Подобную цепочку умозаключений может построить только тот читатель, который может собрать вместе знания о людях и предметах и в целом о том, как устроен мир.

Ни одна система искусственного интеллекта в мире не обладает такими общими знаниями.

Разберем, к примеру, первый вопрос. Когда Альманцо заговаривает с мистером Томпсоном, тот еще не знает, что потерял кошелек, и полагает, что найдет его в кармане. Похлопывание по карману — это проверка вероятности того, что кошелек и правда мог быть утерян. Не обнаружив кошелек на привычном месте, мистер Томпсон делает заключение о пропаже. Пока вы читали историю об Альманцо и кошельке, вы пришли (сознательно или бессознательно) к следующим выводам:

- Люди могут терять вещи и не заметить этого (установка связи между событием и осознанием события).

- Люди часто носят кошельки в кармане (знание о том, как люди пользуются вещами).

- Если дело касается важной для человека вещи, человек захочет незамедлительно проверить ее состояние (знание о том, какие вещи могут быть для человека важными).

- Проверить, лежит ли что-то в кармане, можно и не заглядывая в карман, а просто похлопав по нему (знание о том, как взаимодействуют различные объекты и как работают органы чувств).

Принцип работы искусственного интеллекта не позволяет оперировать общими знаниями и представлениями — лишь вероятностями.

Как правило, искусственный интеллект анализирует, насколько часто слова встречаются вместе в определенных контекстах. Он может генерировать строки, похожие на человеческую речь, но этим поверхностным сходством дело и ограничится.

Чтобы продемонстрировать эту особенность искусственного интеллекта, мы «скормили» историю об Альманцо системе GPT-2, новейшей платформе по генерации текстов, детищу компании OpenAI. По словам создателей, эта система настолько хороша, что ее пока даже не стоит презентовать широкой общественности (несмотря на то, что одна из ценностей компании — это открытый доступ к технологиям AI). Обработав текст, система выдала нам следующее:

It took a lot of time, maybe hours, for him to get the money from the safe place where he hid it, so he brought it back in a bundle and left it on the table. Then he noticed the money that had been hiding in the bed, and began walking toward the bed with a large bundle.

[Перевод]: Ему потребовалось много времени, возможно, несколько часов, чтобы достать деньги из надежного места, после чего он сложил их в пачку и положил на стол. Затем он заметил деньги, спрятанные в кровати, и направился с пачкой денег к кровати.

Текст достаточно связный, а вот идеи звучат непонятно и расплывчато. Как родилось суждение о том, что деньги спрятаны где-то в надежном месте? Системе известно о статистической корреляции между наличностью и надежными местами, но повествовательную нить истории она совсем не уловила.

Современные системы искусственного интеллекта работают на основе совокупности методов машинного обучения и статистического анализа, называемой глубоким обучением (deep learning).

Этот подход замечательно работает при поиске корреляции, например, между изображениями, звуками или логотипами. И он абсолютно беспомощен, когда необходимо понять взаимосвязь между сложными объектами вроде предложений и их частями вроде слов и словосочетаний.

Почему так происходит? Причина в том, что искусственному интеллекту не хватает владения лингвистическим принципом композиционности — умением извлечь смысл сложного высказывания из смысла его частей. Приведем в пример предложение «Расстояние от Земли до Луны составляет 384 400 км». В этом предложении расстояние представляет собой интересующий нас параметр, «Земля» и «Луна» — астрономические объекты, а 384 000 км — это значение параметра. Всё это мы понимаем, расчленяя предложение на составные части и анализируя смысл каждой из них.

Глубокое обучение не предоставляет инструментов для обработки композиционности. Этот метод предполагает неструктурированный поиск огромного количества корреляций в массиве данных.

Система не определит собаку как животное с головой, хвостом, четырьмя ногами; она вообще не сможет понять, что такое животное и что такое голова, и как головы отличаются у лягушек, собак и людей.

Точно так же система искусственного интеллекта не поймет, что в предложении «Расстояние от Земли до Луны составляет 384 400 км» есть словосочетания, относящиеся к двум астрономическим объектам и расстоянию между ними.

У системы искусственного интеллекта нет контекстуальных знаний. Она научилась предполагать, что слова «кошелек» и «надежное место» часто встречаются вместе, но она не способна прийти к заключению, что человеку свойственно оберегать свое имущество.

Говоря языком когнитивной психологии, при чтении любого текста вы строите когнитивную модель того, что сообщает текст. Читая отрывок из «Маленького фермера», вы постепенно строите мысленную модель происходящего в истории — представляете людей, объекты, события и взаимосвязи между ними. Вы представляете, как Альманцо говорит с мистером Томпсоном, как Томпсон хлопает по своим карманам, как он выхватывает у мальчика кошелек и т. д. После этого вы способны анализировать повествование, отвечать на вопросы о нем, перевести этот текст на другой язык или просто запомнить и потом пересказать кому-то эту историю.

В 2013 году компания DeepMind создала систему, которая играла в игры Atari лучше человека безо всяких когнитивных моделей. Чуть позже эту компанию выкупил Google за 500 млн долларов. С тех пор когнитивные модели считаются устаревшим подходом. Но в играх, где есть фиксированные правила и ограниченный свод действий, можно обойтись без ментальных моделей, а в чтении нет. Сгенерированная с помощью GPT-2 проза занятна, но ее чтение дарит вовсе не те ощущения, которые дает опыт чтения естественной прозы.

В конечном итоге статистические данные не могут заменить общие знания о мире. Для понимания прочитанного системам нужна способность конструировать когнитивные модели, а не статистические вычисления.

Простое количественное увеличение скармливаемых ИИ данных и увеличение вычислительных мощностей — не тот путь, который помог бы справиться с задачами понимания человеческих текстов.

Чтение — это процесс, требующий синтеза знаний, умения объединить известную информацию с тем, что хочет сказать автор. Дети справляются с этой задачей, а вот машины пока что нет.