Видеоигры предсказали господство ИИ?

Еще недавно в Интернете был популярен мем про одного японского разработчика видеоигр – Хидео Кодзиму. Фразой «Кодзима – гений» было принято реагировать на любое упоминание геймдизайнера. И хотя с этим тезисом можно поспорить, Кодзима остается одним из самых значимых авторов игровой индустрии. Особого внимания заслуживает одна из его ранних игр, Metal Gear Solid 2, вышедшая в 2001-м году. В ней он не только уловил важные черты современности, но и во многом предсказал будущее, в котором мы живем прямо сейчас.

Контроль vs контекст

Metal Gear Solid 2: Sons of Liberty – как и другие части франшизы – это классический шпионский боевик со всеми присущими ему атрибутами: высокотехнологичными гаджетами, генномодифицированными солдатами, тайными организациями, злыми русскими и, конечно, ядерным оружием. Главный герои игры – молодой агент с позывным Райден, который должен спасти президента США и остановить готовящийся теракт.

Однако по ходу игры и герой, и игрок узнают, что все не то, чем кажется на первый взгляд. Миссия оказывается спектаклем, который должен был показать, насколько сильно контекст определяет личность, ведь события, которые происходят с Райденом, повторяют сюжет первой части франшизы, что заставляет поставить под сомнение свободу воли героя.

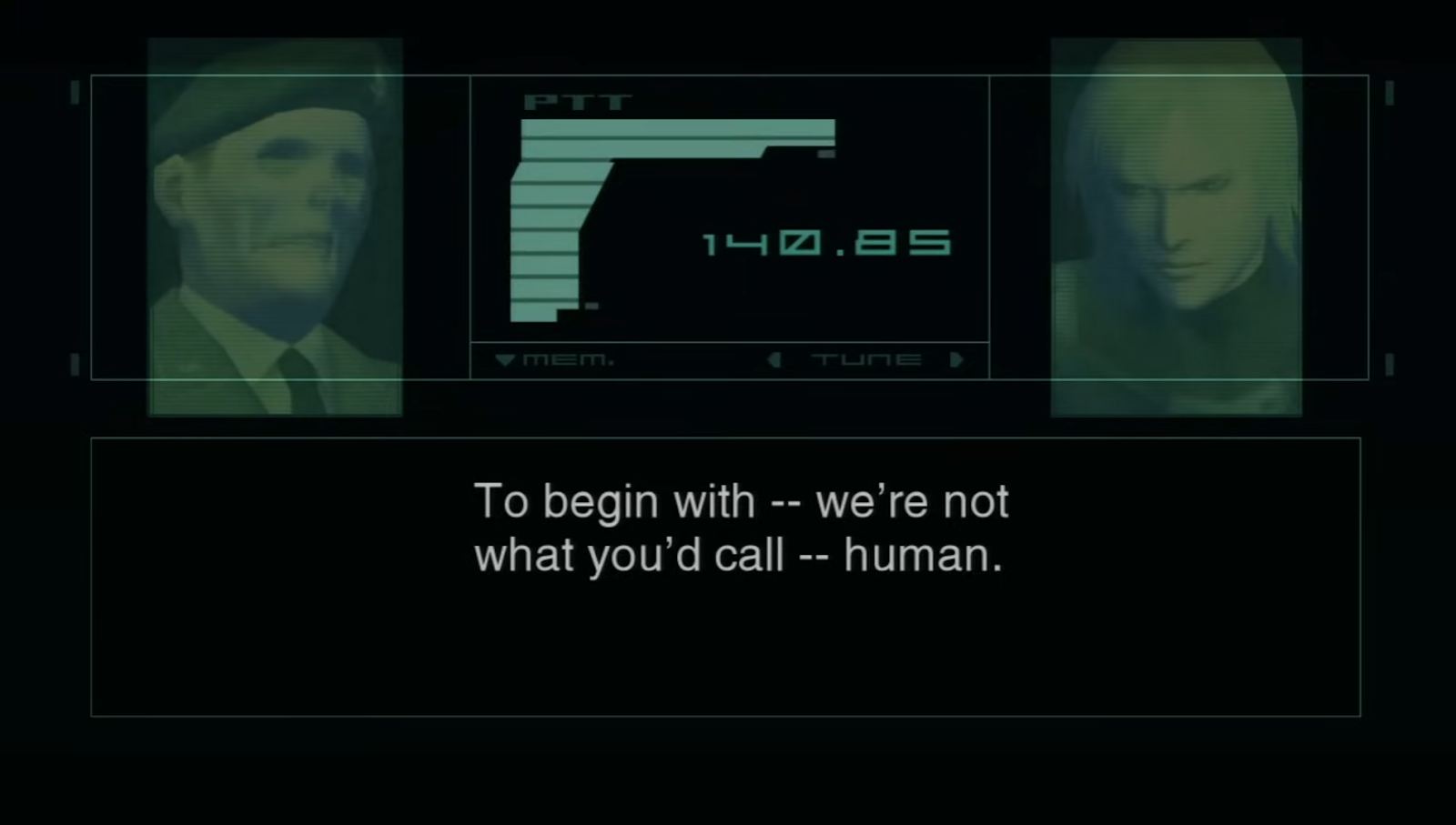

В финале игры с Райденом связывается искусственный интеллект, который руководил всем процессом, и объясняет свою мотивацию. Он ссылается на концепцию Р. Докинза о том, что, помимо передачи генов, человечество также передает мемы – единицы культурной информации. Как и в случае с генами, мемы проходят естественный отбор, в результате чего остаются только самые «живучие» из них.

Искусственный интеллект утверждает, что в цифровом обществе человечество утратило возможность фильтровать мемы, а потому его цель – переход к цензуре нового поколения: «Мы предлагаем не контролировать контент, а создавать контекст».

Аргументируя свою позицию, ИИ указывает на то, что множество противоположных точек зрения, порожденных различными интересами, безостановочно перемешиваются и накапливаются в песочнице политической корректности. Каждый может закрыться в собственном информационном пузыре и потреблять только ту «правду», которая подходит лично ему: «Никто не ошибается, но никто и не прав».

На возражения Райдена о том, что он сам будет решать, какую информацию считать правдивой, а какую – ложной, ИИ отвечает, что герой некомпетентен для этого и даже его свобода воли – не более чем еще одна удобная «правда».

Преувеличение или реальность?

На самом ли деле ИИ из Metal Gear Solid 2 описывает действительность 2001-го года? Только частично. Да, с развитием компьютерных технологий и появлением Интернета количество информации, доступной отдельному человеку, возросло во множество раз. Уже на момент выхода игры существовали форумы, на которых пользователи могли обсуждать интересные им темы и общаться с теми, чьи взгляды им импонируют. Однако Интернет тех лет имел серьезные ограничения: мобильный доступ был редкостью, скорость соединения — в десятки раз ниже, чем сегодня, а загрузка видео, фото и музыки превращалась в испытание.

И, конечно, никаких видеохостингов, стриминговых платформ и социальных сетей не существовало ни в каком виде. То есть, несмотря на революционное развитие способов распространения информации, говорить о перенасыщении ей вряд ли будет правильным. Но в случае с Metal Gear Solid 2 это лишь указывает на то, что Хидео Кодзима не описывал действительность, а, заметив тенденцию, предсказывал будущее.

Уже через каких-то 10 лет мир, который описывает ИИ, стал реальным. Со временем у людей появилась возможность получать всю необходимую информацию, не выходя из Интернета. Сейчас мы можем изучать только то, что нам интересно, общаться только с теми, с кем мы хотим, и главное, верить в то, что удобно нам. Не найдется такой идеи, в пользу которой в Интернете не будет аргументов – теперь чему угодно можно найти подтверждение. Ориентироваться в потоках данных стало намного труднее, и необходимость отделять истину от лжи легла на плечи пользователей, многие из которых оказались не готовы к этому.

В итоге предсказанное ИИ формирование информационных пузырей стало частью нашей повседневности: люди замыкаются в среде, где звучат только их собственные взгляды, игнорируя альтернативные точки зрения, независимо от их объективной ценности.

Но в сравнении нынешней действительности и Metal Gear Solid 2 можно пойти еще дальше, ведь ИИ, похожие на описанный Кодзимой, уже давно существуют. Многочисленные алгоритмы, которые рекомендуют нам одежду, еду, посты в соцсетях, видео, фильмы, товары для дома – все они работают по схожему принципу. Наблюдая за нашими предпочтениями, искусственный интеллект предлагает нам только то, что мы хотим видеть.

Иногда нас может это пугать, например когда после единственного упоминания какой-либо вещи мы уже видим ее в рекомендациях на Авито, но в основном такое положение дел кажется нам удобным. И ведь, в конце концов, все это сделано лишь для удобства, а не для ограничения: ИИ из MGS 2 сам решает, какая информация правильна, но существующие алгоритмы опираются исключительно на наши предпочтения.

И это действительно так: рекомендации – это скорее еще один способ информационной изоляции. Но что если появятся ИИ, которые действительно будут контролировать распространение «правды»?

Нейросети и «правда»

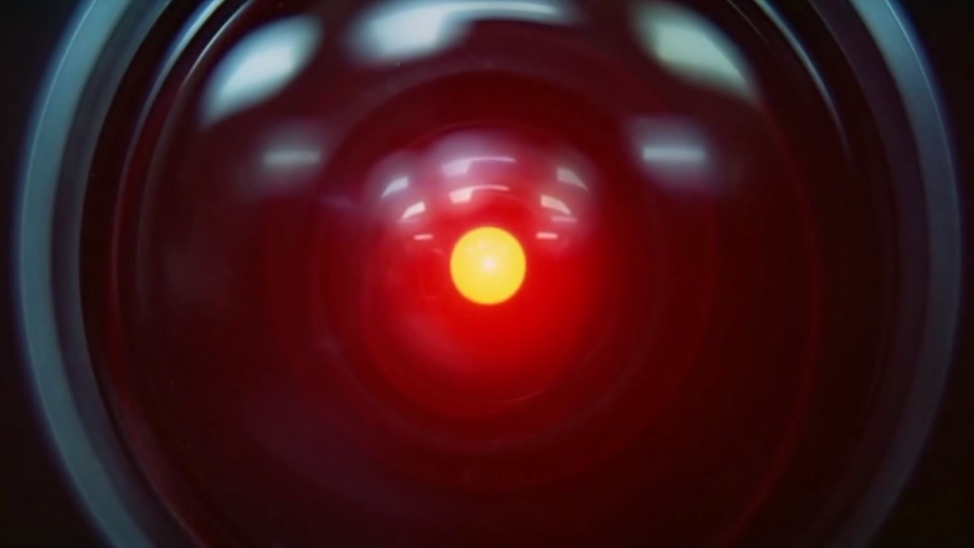

Всего несколько лет назад, в 2022-м году, был разработан чат-бот с генеративным искусственным интеллектом – ChatGPT. Сейчас едва ли не каждый человек знает о том, что это такое. ChatGPT может общаться с пользователем, писать за него эссе и статьи, создавать код, придумывать сюжеты для фильмов, обрабатывать изображения и отвечать на вопросы на самые разные темы. С каждым годом нейросеть развивается и совершенствуется в качестве ответов.

Казалось бы – это прекрасно, что у нас появился такой инструмент, который может просмотреть огромные массивы информации и выбрать из них только самое ценное, только то, что является правдой. Но разве это не означает, что ChatGPT – это и есть ИИ из Metal Gear Solid 2?

В обычной поисковой системе пользователь всегда будет видеть несколько вариантов ответа на свой вопрос, и на каждом сайте потенциально может быть высказана уникальная точка зрения. Хотя в действительности многие из них повторяются, по крайней мере существует возможность увидеть альтернативные позиции, пусть некоторые из них и придется искать дольше.

Однако ChatGPT предлагает уже готовый ответ, в котором до недавнего времени даже не было никаких ссылок на источники. Но главное здесь то, что ChatGPT предвзят в своих ответах.

Если спросить его об этом напрямую, он скажет, что политически нейтрален, однако исследования показывают, что ChatGPT имеет вполне конкретную позицию и на политическом компасе находится в координатах «libertarian-left».

Со временем предвзятость может прийти к минимуму, но даже если сейчас попросить ChatGPT написать оду Дональду Трампу, он оговорится, что постарается сохранить нейтральный тон и отразить противоречивость фигуры, тогда как оду Джо Байдену ИИ пишет без аналогичной оговорки. И подобных способов «обмануть» ChatGPT и заставить его давать не такие уж нейтральные ответы существует немало.

Как и ИИ из MGS 2, ChatGPT фильтрует многочисленную информацию из Интернета, затем, пусть не так явно и бескомпромиссно, проверяет ее на соответствие определенной картине мира и только потом преподносит ее пользователю. И как бы человек ни старался, какие-то точки зрения нейросеть откажется защищать при любом раскладе – просто потому, что с ее точки зрения это противоречит этике. Это не означает, что реальность MGS 2 наступила, – пока что пользователь сам волен решать, к каким источникам ему обращаться, и ChatGPT – только один из них.

Но должны ли мы вообще бояться ИИ и его развития? Окажемся ли мы заложниками иллюзии собственной свободы, как Райден, и смогут ли нейросети в будущем полностью контролировать распространение информации? Вряд ли.

Но при этом нельзя забывать, что любой ответ ChatGPT не является истиной, и его все еще необходимо проверять. А если вдруг ИИ отказывается отвечать на какой-то вопрос или становится очевидно, что он отвечает предвзято, то это лишь помогает определить его слабые места и понять, что с подобными вопросами к нему обращаться не стоит.