Предиктивный анализ или свобода воли: стоит ли позволять нейросетям предсказывать наше поведение

Современные алгоритмы предсказывают поведение людей, оценивая, например, возможность поста завируситься — но эти прогнозы в свою очередь оказывают влияние на поведение людей. Таким образом, весьма произвольные выводы, сделанные искусственным интеллектом, порой превращаются в самосбывающиеся пророчества. Автор книги «Приватность — это власть» и профессор оксфордского Института этики ИИ Варисса Велис объясняет, почему предикитивный анализ человеческого поведениям может быть не только ошибочным, но и вредным для общества.

Алгоритмы оценивают степень индивидуальных рисков при выдаче кредита, приеме на работу, продаже квартиры, оформлении страховки и во многих других случаях. Предиктивный анализ проникает во всё большее количество сфер нашей жизни. Прямо сейчас десятки алгоритмов составляют прогнозы вашего будущего — хотя разрешения у вас никто, скорее всего, не спрашивал.

Надзор над нейросетями не осуществляет ни один государственный орган. Никто не ставит нас в известность о том, что мы подвергаемся анализу, результаты которого влияют на нашу судьбу. Более того, никто не задумывается об этической стороне предсказания поступков людей — существ, которые, по всеобщему признанию, наделены свободной волей.

Идти наперекор судьбе — это часть человеческой природы. Именно так поступали наши великие герои: Авраам Линкольн, Махатма Ганди, Мария Кюри, Хелен Адамс Келлер, Роза Паркс, Нельсон Мандела и многие другие. Все они преуспели вопреки ожиданиям. В нашем обществе поощряется стремление к преодолению ограничений.

Однако используя ИИ для категоризации людей и прогнозирования их будущего, мы тем самым отрицаем свободу воли.

История предсказаний началась задолго до появления дельфийского оракула. Решения о начале или прекращении военных действий нередко принимались на основании предсказаний, а относительно недавно те же методы использовались для расчета страховых взносов. Эти последние предсказания обычно касались крупных групп людей — например, страховые компании составляли прогноз, сколько из ста тысяч людей попадут в аварию. Несмотря на то, что некоторые люди более осторожны, чем другие, страховые взносы были примерно одинаковыми для всех, а большие затраты на менее осторожных и удачливых компенсировались меньшими затратами на более осторожных и удачливых. Чем крупнее была группа, тем точнее рассчитывался размер взноса.

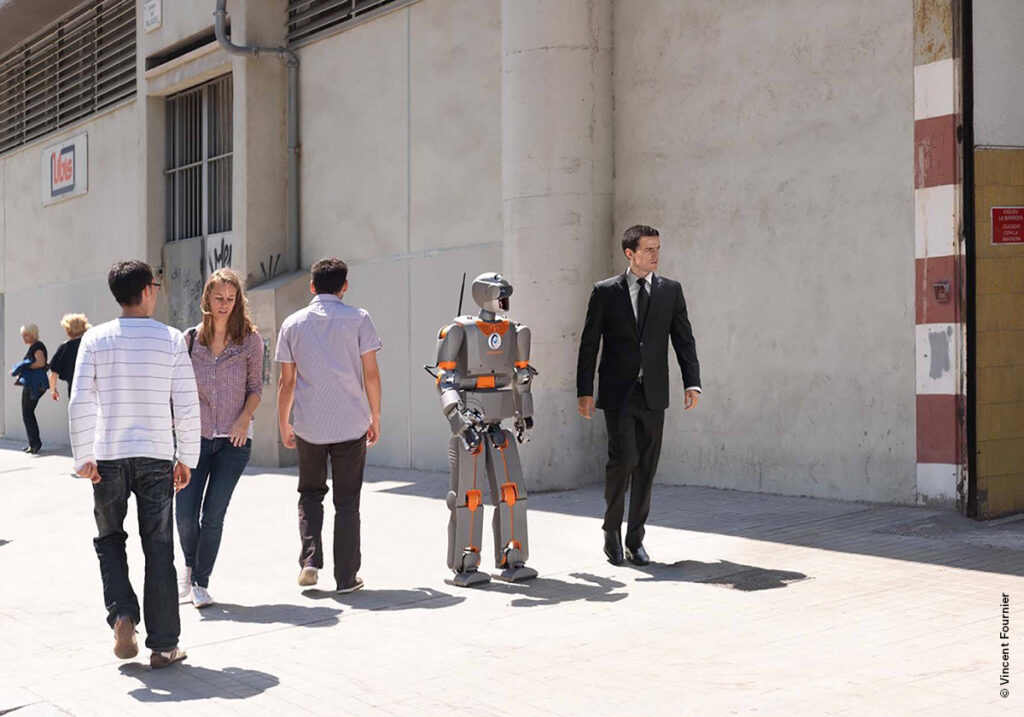

Сегодня роль предсказателей взяли на себя алгоритмы машинного обучения, которые заполняют пробелы в нашем знании при помощи статистических данных. Существуют алгоритмы, которые, пользуясь огромными корпусами текстов, способны предсказать наиболее вероятное окончание предложения. Игровые алгоритмы обрабатывают данные уже сыгранных партий для предсказания наилучшего хода в текущей игре. А алгоритмы, анализирующие поведение человека, используют данные о нашем прошлом для предсказания нашего будущего: что мы купим, сменим ли мы работу, заболеем ли, совершим ли преступление и попадем ли в аварию.

При такой модели больше нет необходимости в статистическом обобщении рисков. Современные прогнозы индивидуальны: каждый платит за свою, например, страховку в соответствии с собственным рисковым рейтингом. Это ставит новые этические проблемы.

Ведь в действительности прогнозы не имеют ничего общего с реальным положением вещей.

Прогнозы касаются будущего, а не настоящего, а будущее еще не наступило. Прогноз — это догадка, содержащая в той или иной степени произвольную оценку рисков. Есть более и менее точные прогнозы, но отношение между вероятностью и действительностью намного сложнее, чем может показаться.

Тем не менее компании часто пытаются выдать прогнозы за модель объективной реальности. Даже когда прогнозы ИИ носят сугубо вероятностный характер, они преподносятся как что-то, неизбежно вытекающее из имеющихся фактов — отчасти потому, что мы мало знаем о вероятности, а отчасти потому, что желание избежать рисков подталкивает нас к подтверждению прогноза. Например, если человек с вероятностью 75% будет плохим сотрудником, ни одна компания не станет нанимать его, если есть кандидаты с более низким рисковым рейтингом.

Применение прогнозов составляет этическую проблему, связанную с одним из древнейших вопросов философии: если есть всеведущий Бог, можно ли считать человека по-настоящему свободным?

Если Богу известно всё, что когда-либо произойдет, значит всё уже предопределено. В таком случае свобода воли — не более, чем иллюзия. Такой взгляд получил название теологического фатализма.

Выводы из этой теории следуют самые тревожные: если достоверные прогнозы возможны (кто бы их ни составлял), то прогнозируемое событие неизменно сбудется. В эпоху ИИ ситуация становится особенно неприятной, так как объектами предиктивного анализа теперь являются люди.

Составляя прогнозы относительно поведения человека так же, как мы составляем прогнозы погоды, мы приравниваем людей к неодушевленным объектам. Это важная этическая проблема. Уважение к человеку означает, в частности, признание за ним свободы воли и способности управлять обстоятельствами своей жизни. Утверждая, что возможно знать чье-либо будущее еще до того, как оно наступит, мы лишаем человека свободы действий и возможности опровергнуть предсказание.

Еще одна проблема, связанная с предсказанием поведения человека, состоит в том, что обращение с людьми как с неодушевленными объектами создает эффект самосбывающегося пророчества.

Прогнозы редко нейтральны. Как правило, акт прогнозирования оказывает влияние на реальность. Например, когда Facebook считает, что тот или иной пост станет вирусным, он одновременно максимизирует аудиторию этого поста. Или вернемся к примеру с алгоритмом, предсказывающим, что вы окажетесь плохим сотрудником. Вполне возможно, что ваша неспособность найти работу объясняется не достоверностью прогноза, а тем, что компании прислушиваются к нему. Когда алгоритм помещает вас в черный список, круг ваших возможностей существенно сужается.

Философы прошлого, размышлявшие о теологическом фатализме, говорили, что если Бог всеведущ и всемогущ, то творящееся в мире зло — его вина:

«Примирение безразличия и случайности человеческих поступков с предвидением или же оправдание безусловных велений Божества и в то же время освобождение его от виновности в грехе до сих пор превышали силы философии»,

— так писал Дэвид Юм.

Если составляемые ИИ прогнозы отчасти обуславливают реальность, то ИИ несет ответственность за негативные тенденции, которые мы наблюдаем в цифровом веке: от углубляющегося неравенства и политической поляризации общества до распространения дезинформации и травмирования детской психики.

Повсеместное использование предиктивного анализа лишает нас свободы выбора, а это может иметь катастрофические последствия для всего общества.

На протяжении всей истории люди искали способы преодолеть судьбу. Мы стараемся дать своим детям как можно более качественное образование в надежде, что это поможет им построить лучшую жизнь. Мы стараемся изменить свои привычки, рассчитывая, что станем здоровее. Мы наказываем правонарушителей, чтобы предотвратить новые преступления. Наконец, мы строим наше общество на основе системы заслуг.

Всё это не имело бы никакого смысла, если бы судьбы людей были предопределены.

Представьте себе мир без оценок, штрафов, бонусов и наказаний; мир без попыток изменить будущее; мир, в котором люди покорно исполняют предначертанное. Если бы будущее каждой компании можно было точно предсказать, финансовым рынкам в современном виде наступил бы конец, а с ними — и всей экономике.

Между прогнозированием поведения людей и верой в свободу воли есть непримиримое противоречие. Здоровая доля неуверенности относительно будущего побуждает нас прикладывать больше усилий, а это, в свою очередь, открывает перед нами новые возможности.

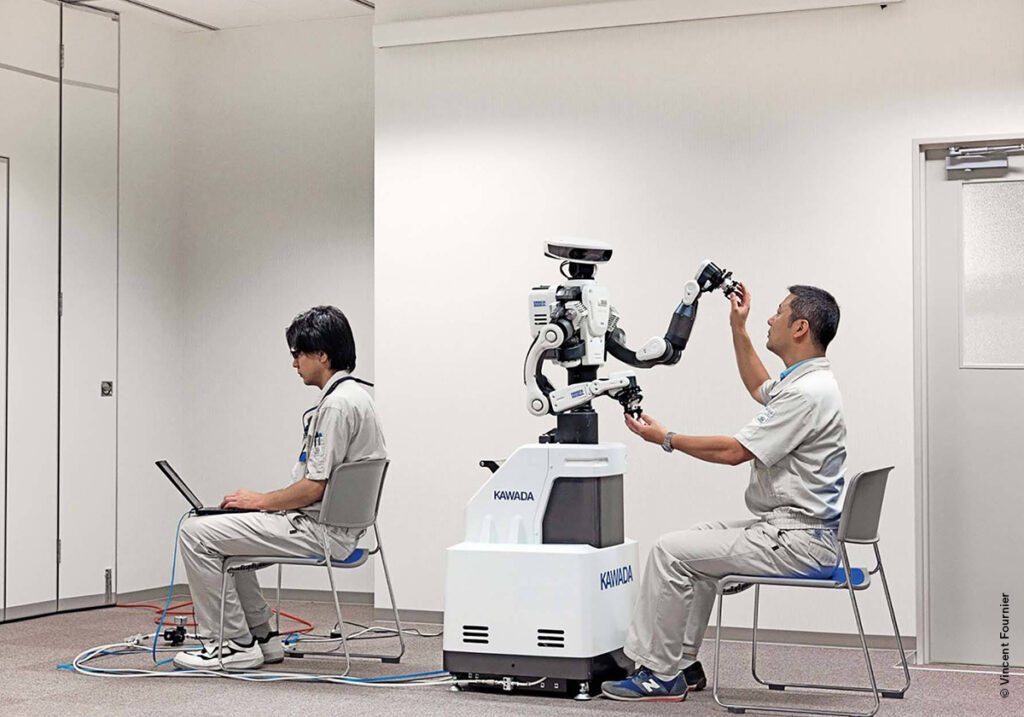

Мы должны сделать выбор: либо мы относимся к людям как к машинам, чье поведение поддается прогнозированию (в таком случае меритократия не будет иметь смысла), либо — как к субъектам (в таком случае прогнозировать их поведение будет некорректно).

Нам бы никогда не пришло в голову отправить в тюрьму трактор. Если люди ничем не отличаются от тракторов, мы никого не должны сажать в тюрьму. Если же люди отличаются от машин, то нам не следует относиться к ним как к машинам, прогнозируя их дальнейшие действия так, как будто от них самих ничего не зависит.

Прогнозы имеют последствия. Повсеместное применение предиктивного анализа может повлиять на представление людей о самих себе.

Исследования показывают, что люди, отрицающие свободу воли, с одной стороны, зачастую более склонны к обману, агрессии и конформизму, а с другой — реже готовы к взаимопомощи, благодарности и искренности.

Применяя предиктивный анализ к людям, мы формируем у них представление, что их личности — не более чем результат обстоятельств; убедившись в этом, они и сами начинают считать себя бессильными. Чем меньше возможностей преодолеть собственные трудности остается у каждого человека, тем сильнее общество в целом обрекается на сохранение статуса-кво.

Определяя судьбу людей при помощи предиктивного анализа, мы превращаем их в роботов.

Способность преодолевать ограничения помогла спасти целые народы. Взять, к примеру, роль Рузвельта и Черчилля во Второй мировой войне. Они преодолели огромные трудности как в личной, так и в профессиональной жизни, и в итоге спасли мир от угрозы тоталитаризма. Способность идти наперекор судьбе — один из величайших даров человеческой жизни. Отрицая ее, мы играем с огнем.